Шахраї імітують голоси рідних: кіберполіція попереджає про нову загрозу

Шахраї імітують голоси рідних: кіберполіція попереджає про нову загрозу

Наразі відбувається бурхливий розвиток штучного інтелекту, а разом із ним шахраї отримують нові можливості для обману потенційних жертв. Зокрема, сучасні технології вже дозволяють з легкістю підробити будь-який голос. Отож за телефонним дзвінком від рідної людини можуть приховуватися аферисти.

Про це повідомляє видання “Інформатор” з посиланням на кіберполіцію.

Компанія Ілон Маск xAI оголосила про запуск технології Custom Voices для свого чат-бота Grok. Нововведення дає можливість імітувати голоси, надавши штучному інтелекту лише короткий аудіозапис.

Зважаючи на появу нових технологій, фахівці кіберполіції дали українцям поради, покликані підвищити безпеку спілкування з рідними. Зокрема, з рідними та друзями варто домовитись про певне секретне слово. Це дозволить перевірити, чи справді телефонує рідна людина. Для цього достатньо під час розмови попросити людину назвати таємний пароль.

Також у разі підозри, що голос людини підроблено, у співрозмовника можна запитати про те, що неможливо віднайти в соцмережах. До прикладу, про колір килима у ванній кімнаті.

Врешті для перевірки можна завершити розмову та самостійно зателефонувати на звичний номер співрозмовника.

Водночас, як попереджають у кіберполіції, шахраї полюбляють створювати тривожну атмосферу та викликати у потенційної жертви відчуття терміновості. У таких випадках головне — зберігати спокій та критичне мислення.

“Подумайте двічі, перш ніж викладати довгі відео чи сторіз зі своїм чистим голосом у відкриті профілі. Це — ідеальний матеріал для навчання нейромереж. Пам'ятайте: технології розвиваються швидше, ніж ми встигаємо до них звикнути. Ваша пильність — найкращий фільтр проти маніпуляцій”, — зазначають у кіберполіції.

Центр Миколаєва заливає стічними водами

Центр Миколаєва заливає стічними водами День морської піхоти: у Миколаєві відбувся автопробіг (фото, відео)

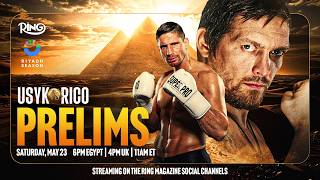

День морської піхоти: у Миколаєві відбувся автопробіг (фото, відео) Усик – Верхувен: де і коли дивитися бій в Україні

Усик – Верхувен: де і коли дивитися бій в Україні Під мостом у Миколаєві рік гниє автобус із Німеччини: салон перетворили на нічліжку (фото, відео)

Під мостом у Миколаєві рік гниє автобус із Німеччини: салон перетворили на нічліжку (фото, відео) Миколаїв накрила потужна злива з грозою: машини пливуть по дорозі

Миколаїв накрила потужна злива з грозою: машини пливуть по дорозі Капібари вперше вийшли до відвідувачів Миколаївського зоопарку

Капібари вперше вийшли до відвідувачів Миколаївського зоопарку Гостросоціальні теми у «короткому метрі»: у Миколаєві показали фільм «Внутрішній Ма..», присвячений проблемі аб'юзу.

Гостросоціальні теми у «короткому метрі»: у Миколаєві показали фільм «Внутрішній Ма..», присвячений проблемі аб'юзу. Виставка бездомних собак у Миколаєві: 10 тварин знайшли нові домівки

Виставка бездомних собак у Миколаєві: 10 тварин знайшли нові домівки У Китаї вперше успішно серійно клонували кіз (відео)

У Китаї вперше успішно серійно клонували кіз (відео)