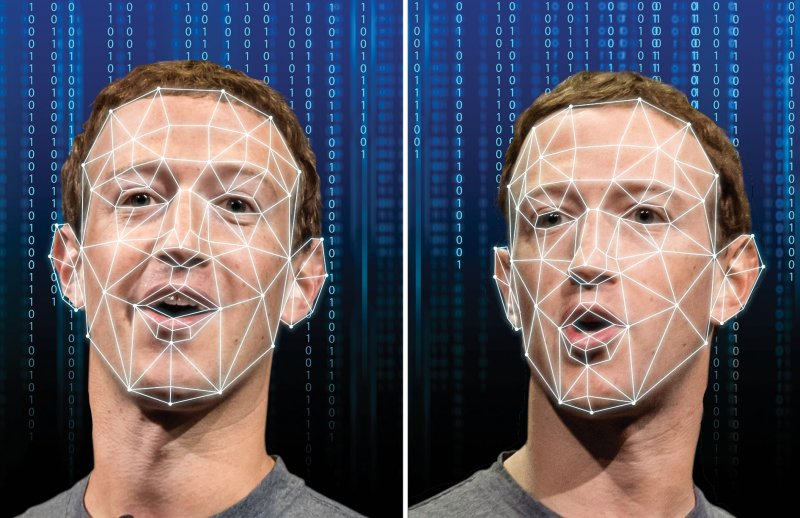

Нова нейромережа створює відео, яке неможливо відрізнити від реальності

Нова нейромережа створює відео, яке неможливо відрізнити від реальності

Open AI розробила нову нейромережу, яка вміє генерувати неймовірно реалістичні відеоролики, які практично не відрізняються від реальності. Експерти побоюються, що подібні зображення можуть бути використані несумлінними маніпуляторами з політичною метою.

У квітні нью-йоркський стартап Runway AI представив технологію, яка дозволяє людям створювати відеоролики на запит — наприклад, про корову на святі або собаку зі смартфоном. Незважаючи на розмитість, уривчастість та перешкоди, чотирисекундні відео свідчать про те, що в найближчі місяці та роки технології штучного інтелекту розвиватимуться в цьому напрямку.

І ось, лише через 10 місяців стартап OpenAI із Сан-Франциско представив аналогічну систему створення відеороликів, які виглядають так, ніби вони взяті з голлівудського фільму. На презентації показали створені за лічені хвилини короткі відео про шерстистих мамонтів, що біжать риссю по засніженому лузі; пухнастого монстрика, що пильно дивиться на свічку, яка тане; і з прольотом камери над вулицями Токіо.

Компанія OpenAI, що створила чат-бот ChatGPT і генератор нерухомих зображень DALL-E, прагне покращити цей вид генерації миттєвих відео поряд зі стартапами та IT-гігантами, у тому числі Google та Meta. Технологія може прискорити роботу досвідчених кінематографістів, повністю замінивши непрофесійних фахівців із комп'ютерної графіки. Також вона може стати швидким та недорогим способом генерування онлайн-дезінформації, що ще більше ускладнить розуміння різниці між реальним та нереальним на просторах мережі.

"Я в абсолютному жаху від усвідомлення того, яку роль подібні речі відіграватимуть на виборах з гострою конкуренцією", - каже професор Вашингтонського університету Орен Еціоні, засновник некомерційної організації True Media, в функції якої входить виявлення дезінформації в ході політичних кампаній.

OpenAI називає нову систему Sora, що в перекладі з японської означає "небо". Її творці, до яких входять дослідники Тім Брукс і Білл Піблз, обрала цю назву як символ "безмежного творчого потенціалу". В одному з інтерв'ю вони зазначили, що для широкої публіки Sora поки що не доступна з огляду на продовження тестування на предмет небезпек системи. Компанія ділиться технологією поки що лише з невеликою групою вчених та незалежних дослідників, які "тестуватимуть її на предмет загроз ззовні". "Мета тут полягає в тому, щоб дати попередній огляд на події найближчого майбутнього, щоб люди могли побачити можливості цієї технології, а ми отримати зворотний зв'язок", - сказав доктор Брукс.

OpenAI маркує створені системою відео водяними знаками, що їх ідентифікують як згенеровані ШІ. Водночас у компанії визнають, що їх можна видалити або зробити максимально непомітними. Ця система є прикладом генеративного ШІ, здатного миттєво створювати тексти, зображення та звуки. Подібно до інших аналогічних технологій система OpenAI навчається за допомогою аналізу цифрових даних — у цьому випадку відео та титри до них.

OpenAI відмовилася вдаватися до подробиць про кількість та джерело роликів, на яких навчалася система, зазначивши лише, що у добірці були як загальнодоступні, так і ліцензовані правовласниками відео. Компанія не особливо поширюється на дані, що використовуються для навчання за її технологіям через бажання зберегти перевагу перед конкурентами — і на неї неодноразово подавали до суду за використання матеріалів, захищених авторським правом.

Так, у грудні газета New York Times подала до суду на OpenAI та її партнера Microsoft, заявивши про порушення авторських прав на контент новин, пов'язаний з ШІ-системами.

Sora створює відеоролики на запит з коротким описом, наприклад "майстерно змодельований з паперу кораловий риф з достатком різнокольорових рибок та інших морських мешканців". Відеоролики хоч і вражають, але не завжди ідеально виконані чи містять дивні/нелогічні зображення. Нещодавно, наприклад, система згенерувала відео, на якому хтось їсть печиво, яке при цьому не меншає.

DALLE, Midjourney та інші генератори нерухомих зображень настільки швидко вдосконалюються, що за кілька років навчилися створювати зображення, що практично не відрізняються від фотографій. Це ускладнило виявлення дезінформації в Інтернеті, а багато фахівців із комп'ютерної графіки скаржаться на труднощі з пошуком роботи.

"У 2022 році ми всі сміялися з новоявленого Midjourney і міркували про те, як це мило, - каже кінохудожник з Мічигану Рід Саутен. - А зараз народ втрачає через нього роботу".

The New York Times , США

«Обличчя театру»: яскраві театральні особистості у роботах Ярослава Туріва (фото, відео)

«Обличчя театру»: яскраві театральні особистості у роботах Ярослава Туріва (фото, відео) Музика від серця та для душі: Еліна Образцова зіграла авторський концерт (фото, відео)

Музика від серця та для душі: Еліна Образцова зіграла авторський концерт (фото, відео) «Світло всередині нас»: Хореографічний колектив «Карамель» показав ювілейну програму (фото, видео)

«Світло всередині нас»: Хореографічний колектив «Карамель» показав ювілейну програму (фото, видео) Вийшов офіційний тизер документального фільму "Кузьма: Страшно веселий"

Вийшов офіційний тизер документального фільму "Кузьма: Страшно веселий" З'явилися фото та відео з місця обстрілу Миколаєва

З'явилися фото та відео з місця обстрілу Миколаєва У Миколаєві водій «Міцубісі» проїхав на «червоний» біля школи (відео)

У Миколаєві водій «Міцубісі» проїхав на «червоний» біля школи (відео) Масові заворушення у Парижі після перемоги ПСЖ у Лізі чемпіонів: затримано понад 300 осіб (відео)

Масові заворушення у Парижі після перемоги ПСЖ у Лізі чемпіонів: затримано понад 300 осіб (відео) Ведмедиця зупинила киянина, який йшов до Румунії: прикордонники знімали його з дерева (відео)

Ведмедиця зупинила киянина, який йшов до Румунії: прикордонники знімали його з дерева (відео) В Одесі пенсіонери виграли мільйон у лотерею

В Одесі пенсіонери виграли мільйон у лотерею